Après les LLM, les “World Models” seront-ils la prochaine grande étape de l’IA ? l’IA qui veut enfin comprendre le monde… et pas seulement prédire des mots

Pendant trois ans, l’IA générative a surtout impressionné avec du texte, des images et de la vidéo. Mais derrière les démonstrations bluffantes de OpenAI, Google DeepMind ou Anthropic, une critique revient de plus en plus souvent : ces modèles savent générer… mais comprennent-ils réellement le monde ?

C’est précisément là qu’arrivent les World Models (“modèles du monde”). Derrière ce concept un peu abstrait se cache une idée ambitieuse : créer des IA capables de comprendre la logique physique et spatiale du réel, d’anticiper les conséquences d’une action et même de planifier. Un sujet poussé notamment par Yann LeCun, ancien chief AI scientist de Meta, qui estime que les LLM actuels ne suffiront pas pour atteindre une IA vraiment autonome.

Et le sujet n’est plus théorique : en 2026, plusieurs milliards de dollars ont déjà été investis dans des startups et laboratoires spécialisés sur ces modèles du monde.

Réponse rapide : c’est quoi un World Model ?

Un World Model est une IA capable de créer une représentation interne du monde pour :

- comprendre les relations entre objets et événements ;

- anticiper ce qui va se passer ;

- tester mentalement des scénarios ;

- prendre des décisions avant d’agir.

Autrement dit : au lieu de simplement prédire le mot suivant, l’IA essaie de prédire le comportement du monde réel.

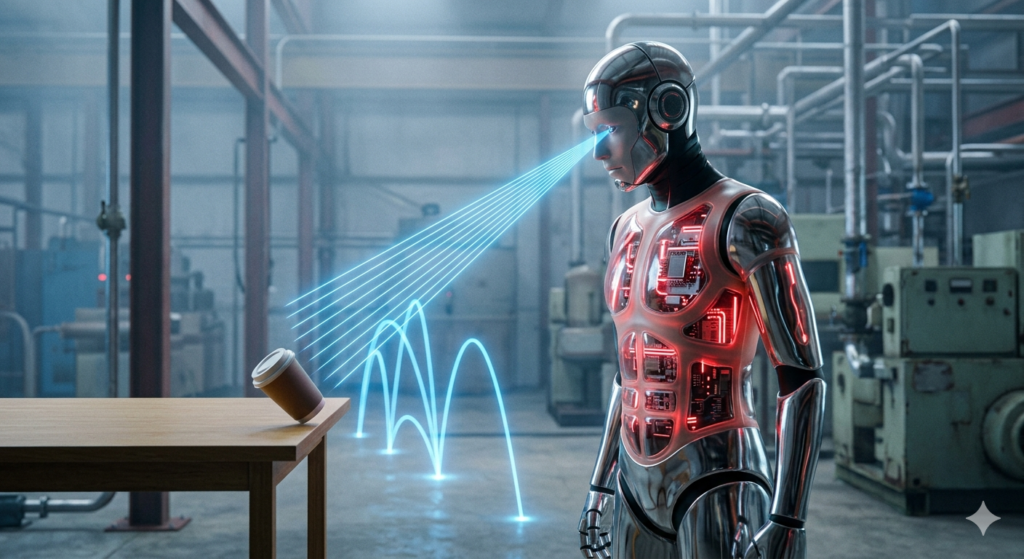

Un enfant qui voit une tasse au bord d’une table comprend intuitivement qu’elle peut tomber. Un LLM classique, lui, sait surtout que les mots “tasse” et “tomber” apparaissent souvent ensemble dans des textes.

Pourquoi les LLM montrent leurs limites

Les modèles comme OpenAI GPT-4o, Anthropic Claude ou Google Gemini reposent principalement sur la prédiction statistique.

Ils excellent pour :

- rédiger ;

- résumer ;

- coder ;

- dialoguer ;

- générer des images ou vidéos.

Mais ils ont encore du mal avec :

- la physique ;

- la logique spatiale ;

- la causalité ;

- la planification complexe ;

- les interactions réelles avec un environnement.

C’est pour cela qu’un robot piloté par un simple LLM peut encore faire des erreurs absurdes :

- confondre devant/derrière ;

- mal estimer une distance ;

- ne pas comprendre qu’un objet cache un autre ;

- oublier qu’un objet continue d’exister hors caméra.

Le pari de Yann LeCun : comprendre avant de générer

Depuis plusieurs années, Yann LeCun défend une approche différente de l’IA générative. Selon lui, les LLM actuels restent limités car ils apprennent principalement à partir du langage. Or les humains apprennent surtout :

- en observant ;

- en manipulant ;

- en expérimentant ;

- en anticipant les conséquences.

Son architecture appelée JEPA (Joint Embedding Predictive Architecture) cherche justement à apprendre une représentation abstraite du monde plutôt qu’à reconstruire chaque pixel ou chaque mot. En mars 2026, sa startup AMI Labs a levé plus d’1 milliard de dollars pour accélérer cette approche.

D’autres géants travaillent déjà dessus

Le sujet attire désormais tous les grands acteurs de l’IA.

Fei-Fei Li et World Labs

La célèbre chercheuse, souvent surnommée “la marraine de l’IA”, développe chez World Labs des modèles capables de comprendre l’espace 3D et les environnements physiques.

Google DeepMind

DeepMind pousse aussi fortement les modèles du monde avec la famille de modèles Genie capables de générer et simuler des environnements interactifs.

NVIDIA

Le groupe mise sur des plateformes de simulation destinées à entraîner des robots et véhicules autonomes dans des mondes virtuels avant leur déploiement réel.

OpenAI

Même si OpenAI communique peu sur le terme “world model”, beaucoup de chercheurs considèrent que Sora ressemble déjà à une première étape vers des simulateurs du monde capables de modéliser des dynamiques physiques.

À quoi cela servira concrètement ?

C’est là que le sujet devient passionnant pour les entreprises 👇

1. Des robots enfin réellement autonomes

Les robots industriels ou logistiques pourront :

- anticiper les mouvements ;

- éviter des erreurs ;

- comprendre un environnement inconnu ;

- apprendre plus vite.

Cela pourrait accélérer fortement :

- la logistique ;

- les entrepôts ;

- l’assistance industrielle ;

- la maintenance terrain.

2. Des assistants IA capables de planifier

Aujourd’hui, beaucoup d’agents IA exécutent des tâches mais raisonnent encore mal sur le temps, les contraintes et les conséquences.

Les World Models pourraient permettre :

- des agents métiers plus fiables ;

- une meilleure anticipation ;

- des workflows autonomes ;

- une gestion plus robuste des imprévus.

3. La simulation d’entreprise

Imaginez :

- tester une nouvelle organisation ;

- simuler un flux logistique ;

- prévoir des impacts clients ;

- modéliser des comportements utilisateurs.

Avant même de déployer une décision réelle. Bienvenue dans l’ère des “jumeaux numériques intelligents”.

4. Une IA plus sobre

Autre point intéressant : certains chercheurs pensent que ces modèles pourraient être plus efficaces énergétiquement que les énormes LLM actuels.

Parce qu’ils chercheraient à comprendre des abstractions utiles plutôt qu’à mémoriser l’intégralité du web.Le rêve ultime des DSI : moins de GPU, moins de factures cloud… et moins de sueurs froides 😅

Attention : le concept reste encore flou

Le terme “World Model” devient aussi un énorme mot-valise.

Aujourd’hui, on y met parfois :

- des simulateurs vidéo ;

- des IA robotiques ;

- des moteurs 3D ;

- des modèles physiques ;

- des systèmes de planification ;

- des IA spatiales.

Même les experts reconnaissent que tout le monde ne parle pas exactement de la même chose.

👉 une IA capable de comprendre les règles du monde physique et d’anticiper les conséquences de ses actions. Nous sommes probablement au tout début de cette transition.

”, voici peut-être l’arrivée de “l’IA qui comprend”. Enfin… on l’espère 😏

FAQ

Les World Models vont-ils remplacer les LLM ?

Probablement pas. Les experts imaginent plutôt des systèmes hybrides combinant langage, vision, raisonnement spatial et planification.

Est-ce déjà utilisé en entreprise ?

Oui, surtout dans :

- la robotique ;

- les véhicules autonomes ;

- les simulations industrielles ;

- certains environnements 3D.

Pourquoi Yann LeCun critique-t-il autant les LLM ?

Il considère qu’ils ne suffisent pas pour créer une intelligence autonome capable de raisonner dans le monde réel.

Quel lien avec les robots humanoïdes ?

Les World Models pourraient permettre aux robots de mieux comprendre leur environnement et d’anticiper les conséquences de leurs actions.

Articles connexes sur IAPratique.com

- GPT Image 2 : comprendre la nouvelle génération d’IA visuelle

- Claude Design : Anthropic veut transformer la création visuelle

- Comment sécuriser ses données avec les LLM ?

En savoir plus

- Article du BDM sur les World Models

- AMI Labs (Yann LeCun)

- Reuters – World Labs de Fei-Fei Li

- Reuters – AMI Labs lève 1 milliard

- Business Insider – pourquoi les World Models intéressent toute l’industrie IA

#IA #IntelligenceArtificielle #WorldModels #LLM #Robotique #AgentsIA #YannLeCun #DeepMind #OpenAI #IAPratique