C’est le moteur discret derrière les modèles de langage comme OpenAI, Google DeepMind, Anthropic ou Mistral AI.

L’auto-attention est le mécanisme qui permet aux modèles modernes de comprendre une phrase dans son ensemble, et pas mot par mot comme un élève distrait. Sans elle, pas de GPT, pas de Gemini, pas de Claude. Autrement dit : pas d’IA conversationnelle performante.

🔎 Le problème à résoudre

Avant 2017, les modèles de traitement du langage (RNN, LSTM) lisaient une phrase séquentiellement.

Comme nous quand on lit à voix haute.

Problème :

- Ils oubliaient vite le début d’une phrase longue.

- Les dépendances lointaines (ex : « Le contrat que j’ai signé hier… ») devenaient floues.

- La performance plafonnait.

🚀 2017 : le tournant Transformer

En juin 2017, des chercheurs de Google publient un papier devenu culte :

“Attention Is All You Need”.

Ils introduisent l’architecture Transformer, dont le cœur est le mécanisme d’auto-attention.

👉 L’idée est simple mais brillante :

Au lieu de lire mot après mot, le modèle regarde tous les mots en même temps et décide lesquels sont importants pour comprendre chacun d’eux.

Comment fonctionne l’auto-attention

Prenons la phrase : “Le directeur valide le projet car il est stratégique.”

À quoi renvoie “il” ?

Au directeur ?

Au projet ?

L’auto-attention va :

- Comparer chaque mot à tous les autres.

- Attribuer un poids d’importance.

- Déterminer que “il” est plus lié à “projet” qu’à “directeur” (selon le contexte).

C’est un système de pondération contextuelle dynamique.

🧮 Un peu de technique

Chaque mot est transformé en vecteur numérique.

Trois matrices entrent en jeu :

- Query (Q) → ce que le mot cherche

- Key (K) → ce que les autres mots proposent

- Value (V) → l’information transportée

La formule centrale :

Attention(Q,K,V) = softmax(QKᵀ / √d) V

Traduction marketing :

On calcule une similarité, on normalise, on pondère, et on reconstruit un sens enrichi.

🧠 Pourquoi c’est puissant ?

✔ Compréhension du contexte global

✔ Gestion des longues séquences

✔ Traitement parallèle (donc plus rapide sur GPU)

✔ Base des LLM modernes

Les modèles actuels utilisent la multi-head attention : plusieurs “regards” simultanés sur la même phrase.

📊 Impact réel

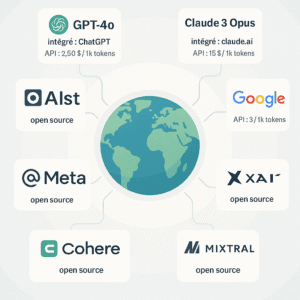

Les Transformers sont aujourd’hui la base de :

- GPT (OpenAI)

- Gemini (Google)

- Claude (Anthropic)

- Llama (Meta)

- Mistral

En 2025, 90 % des grands modèles de langage reposent sur cette architecture ou ses variantes.

⚠ Limites

- Coût mémoire élevé

- Complexité quadratique (O(n²))

- D’où l’émergence de variantes : Flash Attention, Linear Attention, etc.

Les modèles 2024-2026 optimisent ce point pour gérer des contextes de 128K à 1M de tokens.

🧭 Ce que cela change pour vous

Comprendre l’auto-attention, c’est comprendre :

👉 Pourquoi les prompts doivent être structurés

👉 Pourquoi le contexte est roi

👉 Pourquoi le “chunking” est stratégique en RAG

👉 Pourquoi la qualité des données influence directement la pertinence

🧠 FAQ

L’auto-attention veut-elle dire que l’IA comprend comme un humain ?

Non. Elle calcule des relations statistiques.

Est-ce utilisé en dehors du texte ?

Oui. En vision (Vision Transformers), en audio, en multimodal.

Pourquoi parle-t-on de tokens ?

Parce que le modèle ne lit pas des mots, mais des unités numériques découpées.

📚 En savoir plus

Paper fondateur (2017)

Ashish Vaswani et al. – “Attention Is All You Need”

Université de Toronto + Google Brain (2017)

👉 https://arxiv.org/abs/1706.03762

Jay Alammar – The Illustrated Transformer

(Article pédagogique devenu référence mondiale)

👉 https://jalammar.github.io/illustrated-transformer/

Stanford NLP – Cours CS224N

Université Stanford – NLP with Deep Learning

👉 https://web.stanford.edu/class/cs224n/

Flash Attention (2022–2024)

Tri Dao et al. – FlashAttention

Optimisation mémoire et vitesse

👉 https://arxiv.org/abs/2205.14135 Version mise à jour (FlashAttention-2) :

👉 https://arxiv.org/abs/2307.08691

Attention linéaire

Katharopoulos et al. – Transformers are RNNs (2020)

👉 https://arxiv.org/abs/2006.16236

Long Context & Efficient Attention (2023–2025)

Google Research – Longformer / BigBird

👉 https://arxiv.org/abs/2004.05150

👉 https://arxiv.org/abs/2007.14062

Google Research – Transformer Overview 👉 https://research.google/pubs/pub46201/

Anthropic – Scaling Laws & Architecture👉 https://www.anthropic.com/research

OpenAI – Technical reports 👉 https://openai.com/research

MIT Technology Review👉 https://www.technologyreview.com

Nature Machine Intelligence : https://www.nature.com/natmachintell/

#ConceptIA #SelfAttention #Transformer #LLM #IAEntreprise #DataScience #MachineLearning #IAResponsable #AcculturationIA

Vous n'êtes pas abonné ?

S’abonner sur LinkedIn à notre newsletter !