Depuis 2024, les agents d’intelligence artificielle se démocratisent : il suffit d’un outil comme ChatGPT, Perplexity ou Comet pour programmer une action quotidienne, automatiser une réservation en ligne ou contourner un bloqueur.

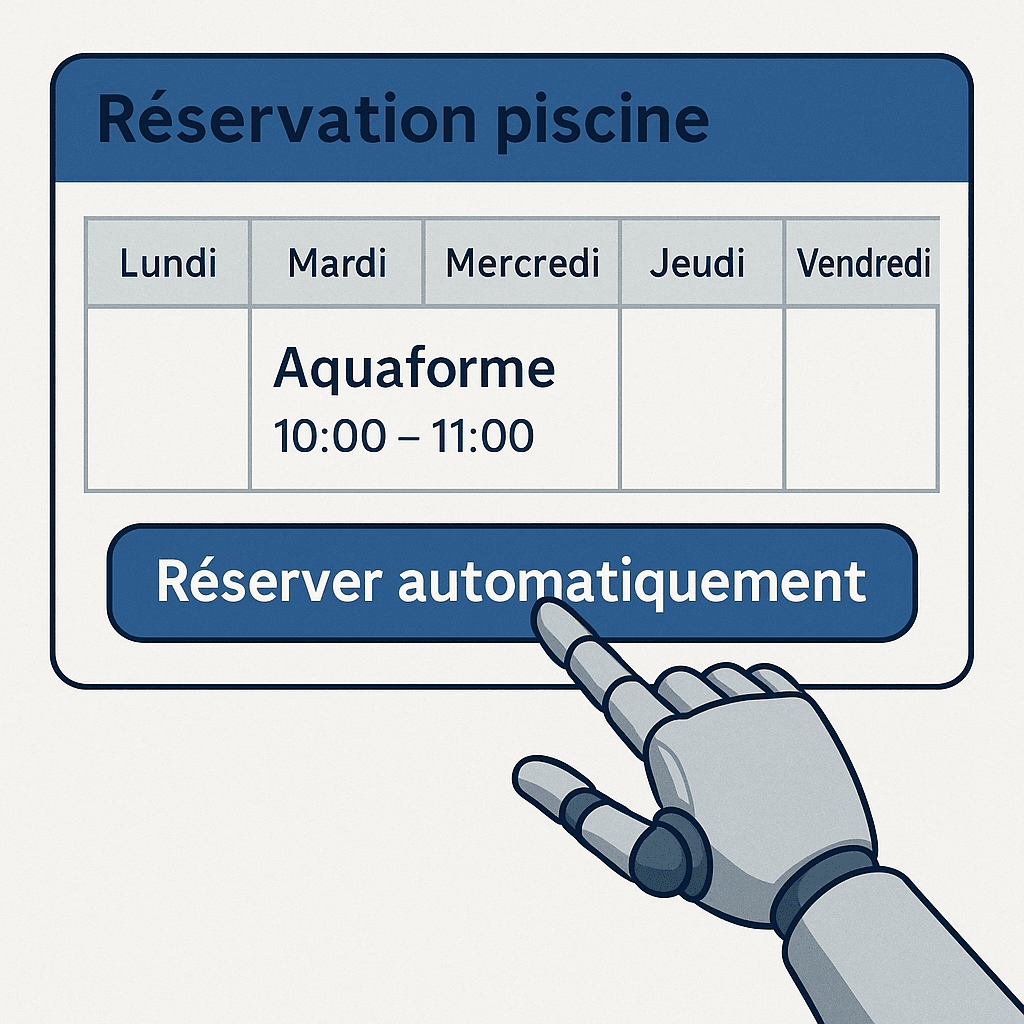

Exemple concret : un agent IA peut être paramétré pour réserver automatiquement un créneau piscine municipal (voir la vidéo ci-dessous).

- Il se connecte chaque jour au portail.

- Il détecte une place disponible (par exemple en “Aquaforme, matin, sauf le vendredi”).

- Il réserve, sans se faire bloquer, ne se trompe pas, ne réserve pas deux fois le même créneau, ne se bloque pas si j’ai déjà une résa.

Ce n’est pas de la science-fiction : c’est possible dès aujourd’hui avec des outils accessibles gratuitement ou pour quelques dizaines d’euros par mois.

La vidéo ci-dessous est réalisée avec un agent peu connu. J’ai masqué le site mais il s’agit d’un éditeur très utilisé dans les collectivités locales pour les réservations de piscines, patinoires, cours de tennis… Il n’y a pas de code, pas besoin de compétence particulière.

Un enjeu d’équité pour les usagers

Les éditeurs de solutions de gestion des activités municipales (sport, culture, loisirs) promettent l’équité. Mais avec ces nouveaux usages :

- Risque de discrimination indirecte : seuls les usagers “technophiles” ou bien équipés bénéficient de l’automatisation.

- Frustration et perte de confiance : les autres citoyens estiment ne plus avoir “les mêmes chances” d’accéder au service public.

- Non-conformité potentielle avec les principes de neutralité et d’égalité d’accès (article L. 100-3 du Code des relations entre le public et l’administration).

Des marchés publics à interroger

La plupart des collectivités passent par des éditeurs spécialisés (portails sports, culture, petite enfance). Or :

- Peu de cahiers des charges intègrent encore la capacité à détecter et bloquer les agents IA.

- Le sujet est absent de la majorité des AMO (assistance à maîtrise d’ouvrage).

- Les risques peuvent mener à des litiges juridiques si des associations ou collectifs d’usagers dénoncent des pratiques biaisées.

Que faire dès maintenant ?

- Demander des garanties à vos éditeurs :

- Détection des bots/agents IA (logs, analyse de comportements).

- Files d’attente aléatoires ou quotas par foyer.

- Captchas évolutifs.

- Réviser vos marchés publics : ajouter des clauses spécifiques liées à la montée en puissance des agents IA.

- Informer vos usagers : montrer que la collectivité est consciente des dérives possibles et agit pour maintenir l’équité.

💡 À retenir : l’IA n’est pas seulement un outil de productivité pour les entreprises. Elle modifie aussi l’accès aux services publics. Les éditeurs de solutions municipales doivent s’adapter… ou exposer les collectivités à un risque social et juridique.

🔎 Sources récentes :

- CNIL – L’IA et l’équité des services numériques (2024)

- Capgemini Research – Agents IA et services publics (mai 2025)

- Gazette des Communes – Dossier : IA, et si on se posait les bonnes questions juridiques (2025)

👉Vous voulez faire tester vos outils ? Contactez IAPratique Studio, notre agence de conseil et services IA.

IA #Collectivités #Éditeurs #ServicesPublics #TransformationNumérique #Éthique