L’IA générative est un formidable outil de productivité… mais aussi un gouffre à données si on ne fait pas attention ! Que ce soit ChatGPT (OpenAI), Claude (Anthropic) ou Perplexity, tous fonctionnent sur le même principe : vous entrez du texte → il part sur leurs serveurs → il est traité, parfois enregistré temporairement. Voici comment profiter du meilleur de ces IA sans mettre en danger vos données personnelles, pro ou confidentielles 👇

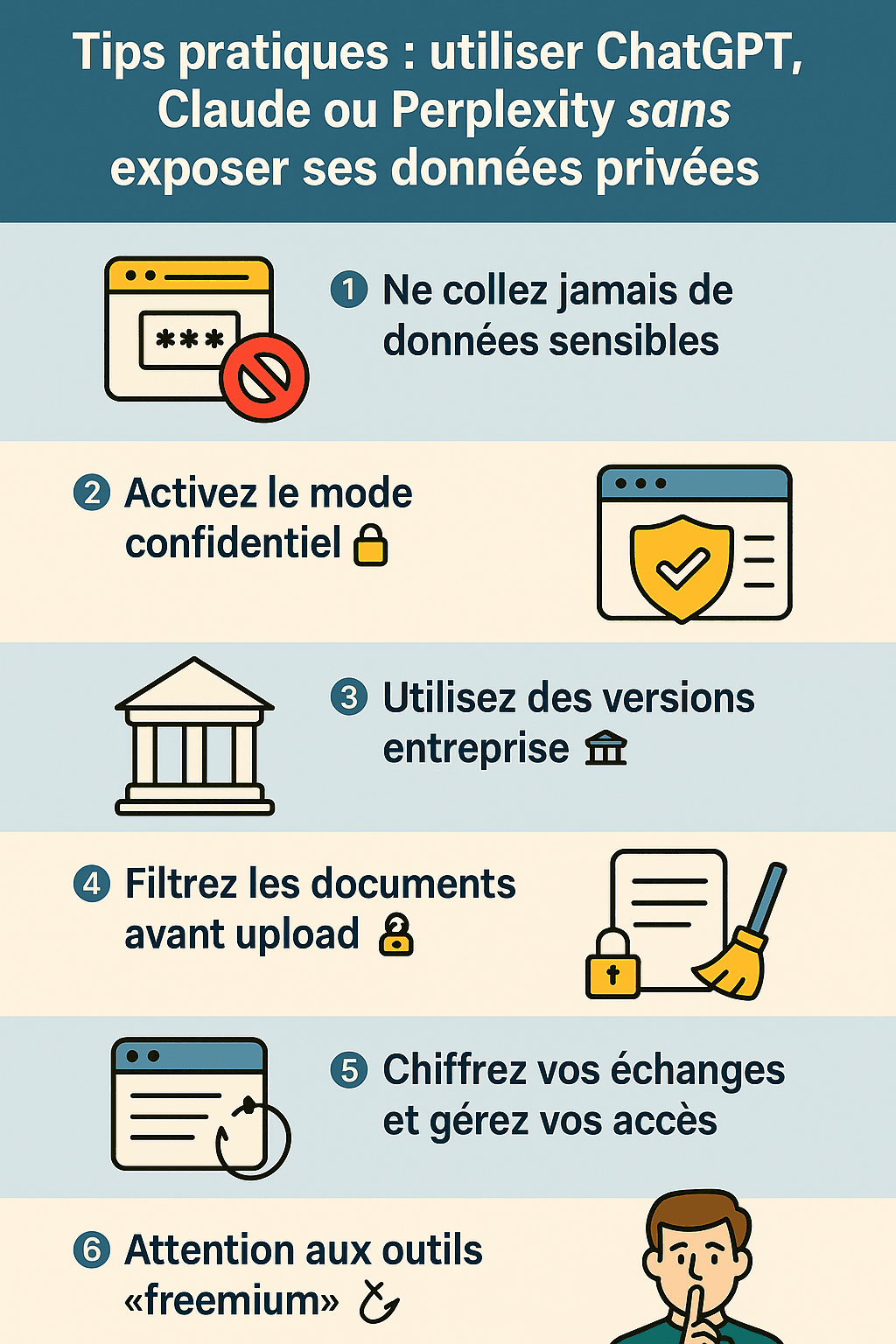

1️⃣ Ne collez jamais de données sensibles 🛑

C’est la règle d’or !

- ❌ N’entrez jamais de mots de passe, numéros de carte, adresses personnelles, ni documents confidentiels (devis, contrats, RIB…).

- ⚠️ Même les noms de clients ou projets internes sont à proscrire (préférez des alias : “Client A”, “Projet X”).

- 💬 Exemple : au lieu de “analyse des ventes Carrefour France”, tapez “analyse des ventes d’un grand distributeur français”.

2️⃣ Activez le mode confidentiel ou “privacy mode” 🔒

- ChatGPT Plus → dans Paramètres → Data Controls, désactive “Improve the model for everyone” → vos conversations ne seront pas réutilisées pour l’entraînement.

- Claude.ai → par défaut, Anthropic ne conserve pas vos données après session, mais vérifiez les politiques dans votre plan entreprise.

- Perplexity Pro → propose un “Private mode” qui empêche la sauvegarde des requêtes sur leurs serveurs publics.

🧩 Astuce PME : créez un compte “pro” dédié pour vos usages IA, isolé de vos outils personnels et mails privés.

3️⃣ Utilisez des versions entreprise ou auto-hébergées

Pour une vraie confidentialité :

- ChatGPT Enterprise / Team → les prompts et outputs ne sont pas utilisés pour entraîner les modèles. (prix : env. 25 $/utilisateur/mois pour Team, 60-80 $ pour Enterprise)

- Claude for Work (2025) : option data-isolée en cours de déploiement.

- Perplexity Enterprise Pro (2025) : stockage chiffré, sans réutilisation de requêtes.

- Pour les plus exigeants : envisagez une IA privée (voir notre article sur l’IA privée), hébergée sur serveur local ou cloud sécurisé (Azure, Scaleway, OVH…).

4️⃣ Filtrez les documents avant upload 🧹

Si vous utilisez des extensions IA pour résumer ou analyser un document :

- ✅ Supprimez d’abord toutes les données identifiantes (noms, adresses, montants précis).

- ✅ Travaillez sur des copies anonymisées.

- 🧰 Utilisez un outil comme Redacta.me, AnonAI ou DocAnonymizer avant envoi.

5️⃣ Chiffrez vos échanges et gérez vos accès 🔐

- 🧱 Privilégiez les connexions HTTPS, VPN et l’authentification multifacteur.

- 👥 Ne partagez pas votre compte ChatGPT (ou API key OpenAI) entre plusieurs collaborateurs.

- 📁 Si vous utilisez des connecteurs (Google Drive, Notion, Slack…), vérifiez les droits d’accès : l’IA peut lire plus de fichiers que prévu !

6️⃣ Attention aux outils “freemium” 🎣

Certaines extensions Chrome, plug-ins IA ou sites “copilotes gratuits” aspirent vos requêtes à des fins publicitaires ou d’entraînement.

🔎 Vérifiez toujours :

- la politique de confidentialité,

- l’origine du site,

- et la date de mise à jour (une politique 2022 = danger).

7️⃣ Bonus : le “prompting anonyme” 🤫

Même sans données sensibles, adoptez une écriture “neutre” :

❌ “Je suis Mariette LG, consultante pour XXX.”

✅ “Je suis une consultante en transformation digitale dans les medias.”

Les modèles IA n’ont pas besoin de savoir qui vous êtes pour vous aider efficacement.

💬 En résumé

| Bon réflexe | Mauvais réflexe |

|---|---|

| Utiliser des comptes pro séparés | Tout faire sur le compte perso |

| Anonymiser les documents | Coller un rapport client brut |

| Désactiver l’entraînement des modèles | Laisser les paramètres par défaut |

| Utiliser IA privée / entreprise | Partager des données sur ChatGPT Free |

| Lire les CGU | Ignorer les politiques de confidentialité |

✨ En savoir plus

- Guide OpenAI – Confidentialité des données utilisateurs (2025)

- Anthropic – Data retention policy

- Perplexity AI – Data handling & Private Mode

- CNIL – Bonnes pratiques IA générative

#Confidentialité #PrivateAI #SécuritéNumérique #IAPratique #RGPD #Cybersécurité