GPT-5.4, la dernière version lancée en mars 2026, se présente comme « le modèle le plus performant et efficient pour le travail pro » selon OpenAI : il fusionne les aptitudes de codage de GPT-5.3-Codex avec un raisonnement avancé et des capacités agentiques (navigation autonome dans le PC). Grâce à son contexte record d’1 million de tokens, GPT-5.4 peut ingérer des contrats ou PDF entiers en une passe. Mieux, en mode Thinking, il affiche d’emblée son plan de réflexion (« chain-of-thought ») pour que vous puissiez ajuster la réponse en cours de route. Le bénéfice : selon OpenAI, ce modèle réduit de 33% les erreurs factuelles, et Box rapporte une hausse d’environ 6 points (72→78%) de précision sur l’extraction de données complexes. Voici 4 cas d’usage concrets, avec prompts et codes d’exemple.

📄 1. Extraction documentaire avancée

GPT-5.4 excelle à analyser des documents riches (contrats, rapports techniques, etc.). Son gigantesque contexte de 1 M tokens permet par exemple de lui envoyer un contrat complet ou un PDF volumineux sans le tronquer. En tests Box, la précision d’extraction a bondi de 72% à 78% par rapport à GPT-5.2 – utile pour automatiser la revue juridique ou financière. Par exemple, pour extraire clauses et obligations d’un contrat :

- Prompt concret : « Vous êtes un assistant juridique. Analysez le contrat suivant et listez les obligations clés et les pénalités associées.

- Snippet (API Python) :

import openai

texte = open("contrat.txt", encoding="utf-8").read() # texte du contrat

resp = openai.ChatCompletion.create(

model="gpt-5.4",

messages=[{"role":"user","content":

"Analysez ce contrat et extrayez ses clauses principales :\n\n" + texte}]

)

print(resp.choices[0].message.content)

Ce code lit le contrat, envoie le prompt à l’API GPT-5.4, et affiche les clauses clés. Les gains sont mesurables : grâce à GPT-5.4, Box souligne qu’on automatise mieux l’extraction de données financières et juridiques complexes (multi-étapes, calculs, longues listes de champs) avec nettement moins d’erreurs.

🤔 2. Mode GPT-5.4 Thinking

En chat (ou via l’API), le mode Thinking de GPT-5.4 permet de voir le plan de l’IA et de le modifier en temps réel. OpenAI illustre : le modèle commence par exposer sa démarche avant de formuler la réponse finale, ce qui évite les allers-retours inutiles. En pratique, vous pouvez demander : « Donne-moi ton plan détaillé avant de répondre ». Exemple de prompt :

- Prompt concret : « Comment augmenter les ventes en B2B ? D’abord, donne-moi un plan en étapes, puis développe chaque point. »

GPT-5.4 affichera un sommaire de sa pensée (« 1. Analyser le marché… 2. Optimiser le CRM… 3. Lancer une campagne… ») pour validation, puis générera le contenu complet. Selon Vice, cette fonction « donne un plan d’emblée pour ajuster la réponse en direct ». Côté sécurité, OpenAI a aussi intégré des tests pour vérifier que GPT-5.4 Thinking ne camoufle pas son raisonnement, et a constaté que ce mode est plus transparent (chaque étape est explicite).

🛠️ 3. CI/CD et revue de code automatisée

Les développeurs et équipes QA peuvent embarquer GPT-5.4 directement dans leurs pipelines (via l’API OpenAI ou des CLI). Par exemple, on peut automatiser des revues de code ou tester des merge-requests. GPT-5.4 comprend le code et le contexte technique (sources, logs, YAML CI) pour détecter bugs ou proposer des tests unitaires. Exemple :

- Prompt concret (CI/CD) : « Voici un diff de code : \n

diff\n+ def calcul(x):\n+ return 2*x\n- def calcul(x):\n- return x*2\n\nDétecte les bugs ou incohérences. » - Snippet (bash/curl) :

curl -s -X POST https://api.openai.com/v1/chat/completions \

-H "Authorization: Bearer $API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5.4",

"messages": [{"role":"user","content":

"Analyse le diff suivant et identifie les bugs potentiels :\n```diff\n+ def calcul(x): return x*2\n- def calcul(x): return 2*x\n```"}]

}'

Ce curl envoie le diff à GPT-5.4 qui souligne immédiatement le changement douteux. On peut aussi orchestrer GPT-5.4 dans un workflow CI : après chaque commit, interroger GPT-5.4 pour générer un rapport de review, mettre à jour la documentation ou tester des scripts avec des frameworks comme Pytest. La token-efficiency améliorée de GPT-5.4 (jusqu’à 70% tokens économisés) rend ces usages en production moins coûteux.

🌐 4. Analyse multimodale (images, tableurs, PDF techniques)

Enfin, GPT-5.4 renforce ses compétences multimodales. Il peut interpréter des images haute résolution (jusqu’à 10M de pixels) avec une grande précision. Par exemple, on peut soumettre un schéma technique ou une photo de plan pour qu’il en commente les détails. Il sait aussi ingérer des tableurs Excel/Sheets directement (via ChatGPT Excel intégré ou en convertissant en CSV). Ainsi, un analyste financier peut demander : « Voici un aperçu du bilan (fichier Excel) : crée un graphique et commente l’évolution du CA ».

- Prompt concret (Excel) : « Ce tableau indique les ventes mensuelles (sheet attachée). Quels sont les mois à fort CA et prévisions ? »

- Snippet (Python + pandas) :

import pandas as pd, openai

df = pd.read_excel("report_financier.xlsx")

msg = "Données financières:\n" + df.head(5).to_string() + "\nQuels KPIs clés en tirer?"

resp = openai.ChatCompletion.create(

model="gpt-5.4",

messages=[{"role":"user","content": msg}]

)

print(resp.choices[0].message.content)

GPT-5.4 lira les données et génèrera graphiques, insights ou recommandations. L’intégration ChatGPT-Excel en bêta (annoncée par OpenAI) rend ces workflows encore plus faciles. En résumé, tout support – PDF techniques, images, tableaux – peut être traité au sein du même modèle avancé.

FAQ

Q1 : Qu’est-ce que GPT-5.4 exactement ?

C’est le nouveau modèle « frontier » d’OpenAI, lancé début mars 2026 pour l’usage pro. Il allie capacités de codage (héritées de GPT-5.3-Codex) et raisonnement avancé, avec en plus des fonctions d’agent autonome (naviguer et exécuter des tâches dans un PC). Résultat : il gère de très longues entrées (jusqu’à 1M tokens) et offre le mode « Thinking » pour voir son plan de réponse.

Q2 : Qu’y a-t-il de nouveau par rapport à GPT-5.2 (ou 5.3) ?

Plusieurs choses : GPT-5.4 réduit de 33% le taux d’erreurs factuelles (vs GPT-5.2), et consomme beaucoup moins de tokens pour un résultat équivalent. Il prend en charge un millier de fois plus de contexte (1M vs ~10k tokens). Le mode Thinking est inédit : le modèle expose sa réflexion en début de réponse. Enfin, GPT-5.4 intègre nativement un outil visuel amélioré (perception haute résolution) et gère mieux les workflows multi-étapes (Tool Search pour utiliser plusieurs plugins sans épuiser le contexte).

Q3 : Est-ce qu’on peut l’utiliser pour automatiser la CI/CD ?

Oui, tout à fait. Par exemple, dans une étape de pipeline CI (GitHub Actions, GitLab CI, Jenkins…), on peut appeler l’API GPT-5.4 pour passer en revue de code ou générer des tests. Par script Bash ou YAML, envoyez un diff ou un extrait de code et GPT-5.4 détectera bugs et suggestions. On peut aussi l’utiliser pour rédiger la doc ou corriger les logs d’erreurs. Les entreprises payantes (Teams/Enterprise) ont déjà intégré des plugins (ESLint, Jest, etc.) pour lui donner accès au code. En résumé : en quelques lignes de script (voir ci-dessus), GPT-5.4 se glisse dans votre chaîne CI/CD pour améliorer détection d’erreurs et qualité de code.

Q4 : Comment profiter du contexte 1M tokens concrètement ?

Avec 1M de tokens, vous pouvez envoyer des dossiers entiers au modèle. Par exemple, une équipe juridique peut charger un archive complet de contrats, ou un dev charger un énorme codebase d’un coup pour refactorisation. GPT-5.4 pourra ainsi garder tout le contexte (même sur des dizaines de milliers de mots) et répondre de façon cohérente. C’est utile pour l’audit de gros fichiers, la consolidation de rapports longs, ou la comparaison de versions. De fait, GPT-5.4 et ses rivaux (Gemini 3.1 Pro le supporte aussi) ouvrent la voie à des analyses massives qui étaient impossibles avant.

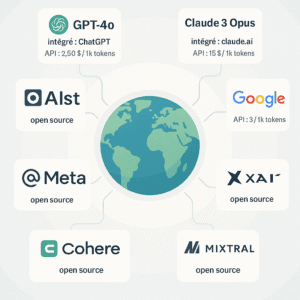

Q5 : GPT-5.4 vs Claude (Anthropic) vs Gemini (Google) : quel est le meilleur ?

La réponse dépend de l’usage. GPT-5.4 domine sur les tâches bureautiques et les workflows pro (il fait 83% sur le benchmark GDPval pour travail de bureau). Claude Opus 4.6 reste devant sur le codage pur (80.8% sur SWE-Bench Verified). Gemini 3.1 Pro excelle en raisonnement abstrait (meilleurs scores en GPQA et logique). Tous trois gèrent le multi-millions de tokens. En pratique on oriente la tâche vers le modèle qui performe le mieux : GPT-5.4 pour l’analyse documentaire et automatisation agentique, Claude pour le code qualité production, Gemini pour R&D scientifique.

Q6 : Y a-t-il des limites ou risques notables ?

Malgré ses progrès, GPT-5.4 n’est pas infaillible. Par exemple, un test du 7 mars 2026 a montré que GPT-5.4 Thinking pouvait répondre à côté de la plaque sur une question simple : à « 100m au carwash, faut-il marcher ou conduire ? » il a écrit un long essai vantant la marche (et tort), alors que Claude et Gemini ont répondu logiquement « conduire ». Cela rappelle qu’une supervision humaine reste nécessaire pour vérifier les réponses, surtout sur l’éthique ou le juridique. En revanche OpenAI indique que GPT-5.4 hallucine moins (–33% sur les affirmations) et qu’un suivi plus fin de sa réflexion permet de mieux détecter les erreurs.

En savoir plus

🔎 En savoir plus

📌 Sources officielles (2026)

OpenAI – Introducing GPT-5.4 (mars 2026)

https://openai.com/index/introducing-gpt-5-4/

Documentation API GPT-5.4 (OpenAI Developers)

https://platform.openai.com/docs/models/gpt-5-4

Box – How GPT-5.4 improves data extraction (mars 2026)

(hausse de précision de 72 % à 78 % sur extraction documentaire complexe)

https://blog.box.com/how-openai-gpt-54-improves-data-extraction

TechCrunch – OpenAI launches GPT-5.4 with Pro and Thinking modes (2026)

https://techcrunch.com/2026/03/openai-launches-gpt-5-4-pro-thinking/

Tom’s Guide – GPT-5.4 Thinking shows its reasoning plan (2026)

https://www.tomsguide.com/ai/gpt-5-4-thinking-mode-explained

📚 À lire aussi sur IApratique.com

GPT vs Claude vs Gemini : quel modèle choisir en 2026 ?

https://iapratique.com/comparatif-gpt-claude-gemini-2026

Comment automatiser 30 % des tâches d’une PME avec les LLM

https://iapratique.com/automatisation-ia-pme-guide-pratique

Tous nos articles sur OPEN AI : #OpenAI

Retrouvez nos articles sur IAPratique.com et abonnez-vous à la newsletter Hebdo sur LinkedIn pour ne rien louper de nos astuces. 🚀🤖

S’abonner à la newsletter IAPratique Hebdo sur LinkedIn#IA #IntelligenceArtificielle #GPT54 #Innovation #Productivité #Développement #DataScience #Tech

GPT-5.4 (mars 2026) est un modèle généraliste de pointe. Il allie codage avancé (intégrant GPT-5.3-Codex) et raisonnement structuré (plan d’exécution), avec 1M tokens de contexte et multimodalité (texte+image). OpenAI signale 33% moins d’erreurs factuelles que GPT-5.2 ;

LImite : latence notable sur gros contextes. Le modèle est classé «cyber-haute capacité» (garde-fous renforcés).

Cas d’usage : automatisation BI (tableurs Excel, bases de données), développement assisté (génération/revue de code), assistants métiers (CRM, tickets, pipeline CI/CD), workflows multimodaux (analyse docs, extraction de données). Ex : prompt API «Nettoie ce tableau Excel et résume les tendances».

Comparaisons : vs GPT-4/4o (1M tokens vs ~128K, plus multimodalité/voix) ; vs GPT-5.2 (bien plus fiable sur tâches longues) ; vs Claude/Gemini (tous 1M tokens contextuels, Gemini excelle en vidéo/audio, Claude en agents collaboratifs).

Conformité : requiert gouvernance stricte (audit, traçabilité, tests de dérive) pour conformité AI Act et régulations (finance, santé…)